SLV 新增支持可加速 Solana Validator PoH 的 SHA-256 优化补丁(即 kagren patch)——PoH speed check 提升 10–20%,通过 AI Agent 将 Epics DAO Validator 的运维洞察交付给所有 SLV 用户

SLV 新增支持可加速 Solana Validator PoH 的 SHA-256 优化补丁(即 kagren patch)——PoH speed check 提升 10–20%,通过 AI Agent 将 Epics DAO Validator 的运维洞察交付给所有 SLV 用户

ELSOUL LABO B.V.(总部:荷兰阿姆斯特丹;CEO:Fumitake Kawasaki)与 Validators DAO 很高兴宣布,由双方共同开发并运营的开源 Solana 开发工具 SLV 现已支持一种优化补丁(即 kagren patch),可加速 Solana validator PoH(Proof of History)所使用的 SHA-256 计算。

在 Epics DAO validator 上完成真实环境验证后,这一补丁已被集成进 SLV,并以同时适用于 Solana validators 与 Solana RPC nodes 的形式提供,任何 SLV 用户只需通过与 AI agent 的对话即可完成应用。

在配备 SHA-NI 指令集的 AMD Zen3 或更新 CPU 上,启动时测得的 PoH speed check 预计可提升 10–20%。这一性能增益会直接转化为 Solana validators 在 leader slots 中可用的额外处理余量。

SLV Website: https://slv.dev/zh

SLV GitHub: https://github.com/validatorsDAO/slv

什么是 kagren Patch——对 Solana Validators 最热路径的精确优化

Solana 的共识建立在一条连续的 SHA-256 哈希链之上,这条链被称为 Proof of History(PoH)。以前一个 hash(32 bytes)作为 input 来生成下一个 hash 的过程,会在单个 slot(约 400 ms)内重复数十万次。在 Solana validator 的所有代码路径中,这一 PoH SHA-256 计算是执行频率最高的部分,也是 CPU time 的主要消耗来源。

所谓的 “kagren patch”,就是一项专门针对这一最热路径的优化尝试。其原作者 kagren 从

solana-sdk 中 fork 出 sha256-hasher,并提供了一个专门面向 PoH 的 32-byte、single-block input 条件的 SHA-NI 实现。这一补丁以 Creative Commons CC0 1.0 Universal License 形式发布,任何人都可以自由使用、修改并重新分发。对于 kagren 以开放方式向整个 Solana 生态做出的这项贡献,我们致以最诚挚的敬意。

solana-sha256-hasher-optimized (kagren): https://github.com/kagren/solana-sha256-hasher-optimized

SHA-NI 指令与面向 32-Byte、Single-Block Input 的确定性优化

SHA-256 是一种按 64-byte(512-bit)block 处理数据的算法。当对 32-byte input 进行哈希时,剩余的 32 bytes 会被按规范定义的 padding 填充——前导

0x80 byte、zero padding,以及尾部表示 input 长度的 bit sequence。关键观察点在于:像 PoH 这样总是对 32 bytes、single block 进行哈希的场景下,这部分 padding 是完全确定的。Kagren patch 会在 SHA-NI 的计算路径上预先展开这些确定性部分,从而移除通用实现中原本存在的 branches、loops 与 loads。结果就是,在 PoH 特有的 32-byte、single-block input 条件下,它能从 SHA-NI 中榨出最大的 throughput。

对于不等于 32 bytes 的 input,或会跨越多个 blocks 的情况,仍然继续使用原本的通用实现。On-chain SHA-256 计算(运行于 SBF 的程序内部 hash 调用)也保持完全不变。该优化只作用于像 PoH 这样反复计算 single-block、32-byte hash 的 workload,对任何其他路径都不会产生影响。

PoH Speed Check 提升 10–20%——直接影响 Leader Slots 中的处理余量

原作者报告称,在 AMD Zen3 或更新 CPU 上,Solana validator 启动时测得的 PoH speed check 值,在应用这一补丁后可提升 10–20%。在 Epics DAO validator 上的真实环境验证中,我们也观察到了相近幅度的提升。

这一提升的意义并不只是一个 benchmark 数字。PoH 的计算余量会直接转化为 Solana validator 在其 leader slots 中拥有的处理余量。Transaction ingestion、Compute Unit accumulation、block production——在 leader slot 的有限时间内,PoH 计算所占用的 CPU time 越少,就意味着可用于其他所有任务的资源越多。

这是一项低调但可靠的改进,能够改善 validator 的关键性能指标:vote latency、skip rate,以及每个 block 可处理的 Compute Units。

不影响 Consensus——完全兼容的 Fallback 设计

在 kagren patch 下执行的 SHA-256 计算,会生成与标准实现完全相同的结果。执行路径根据 input 条件分支:32-byte、single-block input 走优化路径,其余情况则回退到标准实现。On-chain SHA-256 计算保持完全不变。

因此,不存在结构性的 consensus 风险——例如因为 hash 结果与其他 validators 不一致而落入不同 fork。SLV 在部署 patched binary 之前,会先执行验证步骤以确认结果与标准实现完全一致,然后才会进行切换。

目标 CPU 与前提条件

这一补丁只有在配备 SHA-NI 指令集的 CPU 上才会发挥效果。具体来说,适用对象包括 AMD Zen3 及之后的架构——EPYC 7003 / 9004 / 9005 系列、Ryzen 5000 系列及之后、Threadripper 5000 / 7000 系列,以及类似处理器。

Epics DAO validator 运维所使用的主要配置,以及 ERPC 平台上的大多数配置,都满足这一条件,因此 ERPC 的大多数 Solana RPC nodes 与 SLV Metal 系列服务器都能从这项补丁中受益。对于不具备 SHA-NI 指令集的旧一代 CPU,SLV 会跳过补丁应用并继续在标准实现上运行。

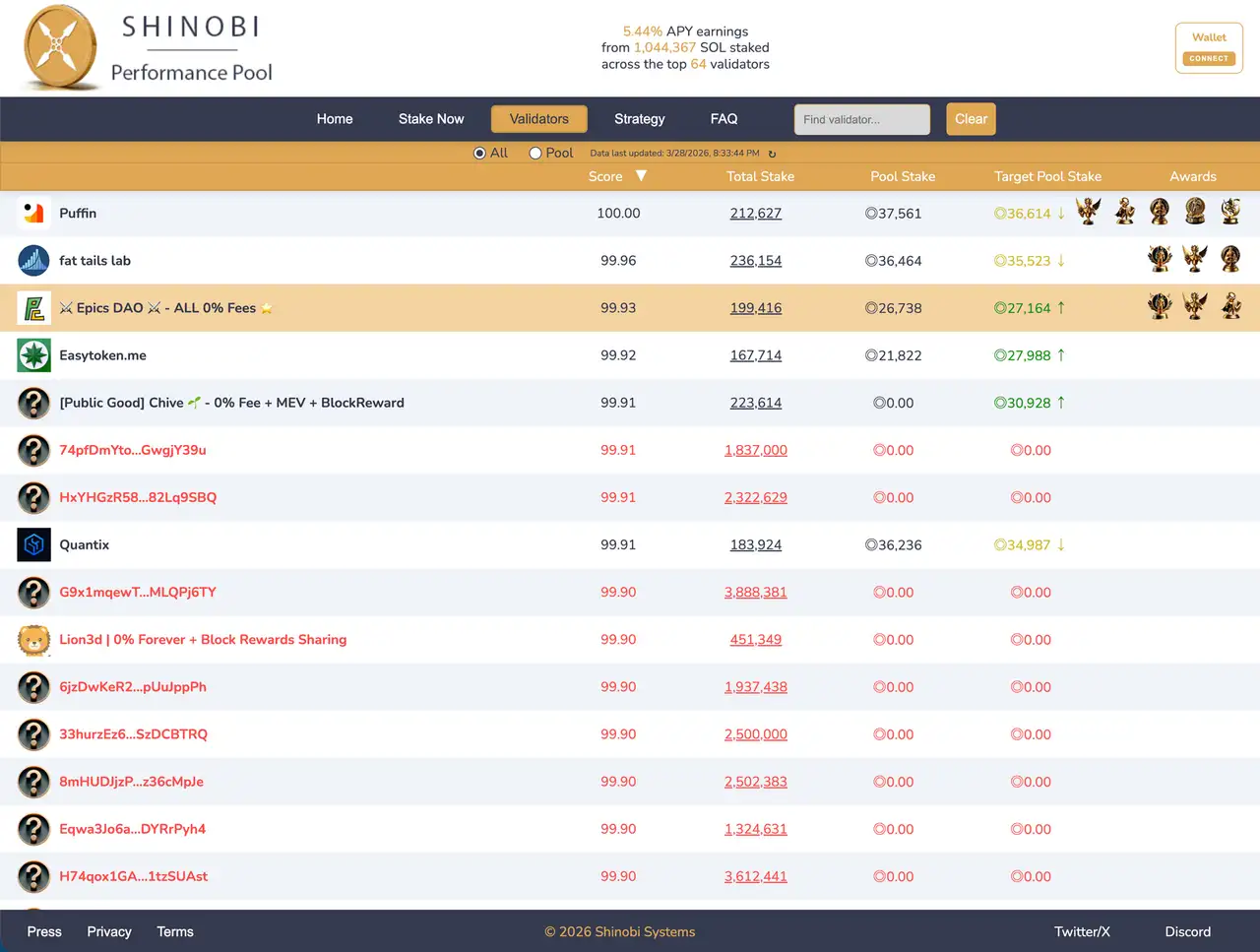

在 Epics DAO Validator 上的真实环境验证——世界第 3 成绩背后的又一块积木

我们作为 ERPC 的 SWQoS endpoints 与 Epic Shreds feed 来源而运营的 Epics DAO validator,已在 Shinobi Performance Pool 中于全部 Solana validators 里达到世界总排名第 3(得分 99.93)。这一结果反映了多项改进的累积:硬件选型、kernel parameters 优化、network stack tuning、IRQ affinity 调整,以及 DoubleZero 集成。

Kagren patch 的整合,是这串累积中的又一项补充。在 Epics DAO validator 上完成真实环境验证、确认其在 production 中的效果与稳定性之后,我们将其作为内建 skill 集成进 SLV。那些已在世界级 validator 运维中被证明有效的优化技术,如今被交付成任何 SLV 用户都可复现的形式。

Validators DAO 的存在,是为了提升 Solana 网络整体的处理质量与容错能力。单个 validator 的性能提升,会直接转化为整个 Solana chain 更高的处理吞吐。一个由 kagren 以 CC0 公开、在 Epics DAO validator 上验证、再通过 SLV 交付给全球 validator operators 的优化——这种把知识回馈出去的循环,正是我们存在理由的核心。

SLV 同时支持 Validator 与 RPC——自动识别 Client,远程 Build 与 Deploy

通过这次发布,Solana validators 与 Solana RPC nodes 都被纳入 SLV 中这项补丁的适用目标。

SLV 会自动检测目标节点上运行的 client 类型(Agave、Jito-Agave),并将合适的 Solana source tree clone 到远程 build 环境中。Kagren patch 的仓库也会自动获取,整个过程——将补丁应用到 PoH hashing logic、为目标 CPU 使用优化 flags 重新 build、备份现有 binary,并 deploy patched binary——都由 SLV 端到端控制完成。

Solana 的 source version 可以显式指定,也可以依据 SLV 所管理的版本信息自动 resolve。它也支持同时对多个节点进行批量应用,覆盖在一整个运维 fleet 中逐步 rollout 该补丁的 use case。

需要注意的是,在 patched binary 部署完成之后,Solana validator 或 RPC 进程的重启将由 operator 另行执行。SLV 负责到 binary swap 为止的全部工作;至于何时重启,则留给每位 operator 自己的策略决定。当 SLV AI agent 在用时,就连 restart 本身也可以交给 agent。

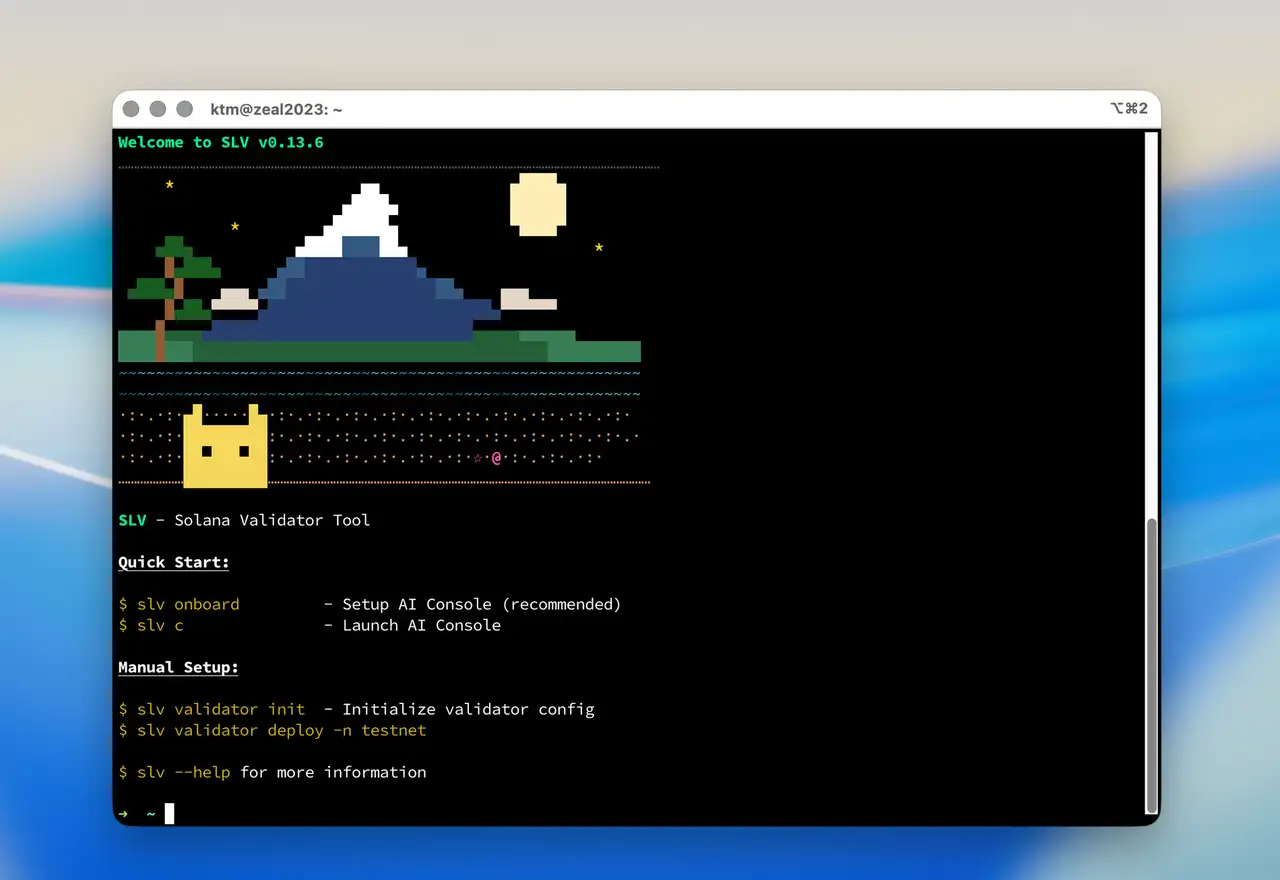

结合 AI Agent——完全通过自然语言完成

和 SLV 的其他功能一样,kagren patch 的应用也是通过 MCP(Model Context Protocol)暴露出来的。只需启动 AI Console,并对 AI agent 说一句类似 “Apply the SHA-256 optimization patch to this validator”,整个流程——目标节点识别、build 与 deploy——就会由 agent 自动选择并执行恰当步骤。

它同样支持直接通过 CLI 执行,因此相同操作也可以被纳入脚本化自动化流程。无论是否使用 AI agent,相同的行为都建立在同一个 MCP 基础之上被复现出来。

到目前为止,给 Solana validator 应用 custom patch,一直要求 operator 自己处理整套流程:clone source code、搭建 build 环境、解决 dependencies、整合补丁、调整 optimization flags,以及替换 binaries。SLV 将这一整套过程抽象成 AI agent 可以代替 operator 完成的形式。

一项 operator 想为提升性能而采用的技术,绝不应该被运维复杂性所阻碍——SLV 在支持 DoubleZero 时提出的这一原则,在 kagren patch 上同样继续贯彻。

支持 Local Mode——从单机到整支 Fleet

除了远程管理之外,SLV 还支持 local mode,即在通过

ssh 抵达的节点上直接运行 SLV。Kagren patch 的应用在 local mode 下同样可用,因此无论是直接对单个运行中的节点应用补丁,还是在基于 Ansible 的远程管理环境下向整支 fleet 推出补丁,都可以在同一个 SLV 环境中完成。对于正从

solv 迁移的用户来说,在 local mode 下应用 kagren patch 是一个很容易上手的切入点。先从一台机器开始,再根据需要扩展到远程管理——SLV 的整体设计哲学同样一致地体现在引入性能调优的路径上。对整个 Solana 网络的贡献

Solana 是一个分布式计算网络。它的性能由遍布世界各地的每一个独立 validator 的性能总和来决定。

每个 validator 在 PoH 计算中获得的 10–20% 余量,在整个网络层面会累积为 leader slots 中更多的处理余量、更好的 vote 跟随精度,以及更稳定的 block production。通过像 SLV 这样的运维平台,把 kagren 以 CC0 发布的优化交付给更多 validators,本身就是在为整个 Solana 网络的性能与容错能力做贡献。

SLV 将继续把那些真正影响实际运维的改进,以只需和 AI agent 对话就能应用的形式提供出来。通过在结构上降低 validator 运维的认知负担,并压低性能改进所需工作的门槛,我们会继续构建一个让更多 operator 能以更高质量运行 validators 的环境。

作为 Open Source 提供——持续回馈知识

SLV 本身仍将继续以 open source 形式提供。包括这次 kagren patch 集成在内的所有功能,都可以从 SLV 的 GitHub 仓库中自由获取与使用。

ERPC 从真实运维与 R&D 中获得的知识,会通过 SLV 的 skills 与 tools 以 open source 形式公开。Epics DAO validator 迈向世界第 3 的过程中积累下来的优化技术、tuning parameters 与运维 know-how——这一切都被浓缩在 SLV 面向 AI agents 的 skills 中,并以全球任何 validator operator 都能复制出同等质量的形式交付出来。

SLV Website: https://slv.dev/zh

SLV GitHub: https://github.com/validatorsDAO/slv

现在就用 SLV AI Tokens 试试

Kagren patch 的应用也可作为 SLV AI agent 功能的一部分使用。借助 SLV AI tokens,整个应用流程都可以通过与 AI agent 的自然语言对话完成。

作为发布促销活动,我们正通过 5€ authorization 免费发放 100,000 tokens——这一额度已经绰绰有余,可以体验通过与 AI agent 的对话来应用 kagren patch。它同样支持通过 ChatGPT 与 Claude API tokens 连接,因此用户也可以使用自己的 API keys 来运行 SLV AI。

ERPC SLV AI Plans: https://erpc.global/zh/price/

与 ERPC 平台结合使用

运行在 ERPC 平台上的全部 Solana validators 与 Solana RPC nodes,都基于 AMD Zen4 或更新 CPU 构建——这些配置都能从 kagren patch 中受益。将通过 SLV 构建的环境部署到 ERPC 平台后,用户从第一天起就能同时获得以下能力:平台内高速 snapshot 下载、与 Solana validators 的 zero-distance 通信、专为 Solana 调优的配置,以及通过 kagren patch 带来的 PoH 加速。

ERPC 将 Solana RPC、Solana Geyser gRPC、Solana Shredstream(Epic Shreds)、bare-metal servers、high-performance VPS 与 ERPC Global Storage 统一整合到单一平台中,所有服务都通过内部网络路径以 zero-distance 设计互联。DoubleZero 的 dedicated fiber network 也已集成到全部区域,其中在亚洲区域(东京和新加坡)尤为显著,实现了约 200 ms 的 P99 latency reduction。

ERPC Website: https://erpc.global/zh

连续五年获得 WBSO 批准——AS200261 Solana 专用数据中心

ELSOUL LABO 自 2022 年以来,已在荷兰政府的 WBSO 研发支持计划下连续五年获得批准。围绕 Solana RPC 基础设施、validator placement 与 operational orchestration,以及由 AI agents 驱动的 Solana 运维环境建设所取得的持续研发成果,都被直接实现到 SLV 的 toolset 与 AI agents 中。

作为这些研发成果的集大成者,我们正在建设一座运行于自有 ASN(AS200261,由 RIPE NCC 分配)下的 Solana 专用数据中心。借助统一标准化到最新一代硬件——AMD EPYC 第 5 代、AMD Threadripper PRO 第 5 代(9975WX 及以上)与 NVMe Gen 5——并结合由自有 ASN 支撑的最优 network path 设计,这座设施将提供超越现有 premium datacenters 的顶级质量。数据中心计划于本月开放,并将为 SLV AI agents 所构建环境的进一步加速提供支撑。

致谢 kagren

如果没有 kagren 在

solana-sha256-hasher-optimized 仓库中公开的工作,这次整合到 SLV 之中就不可能实现。我们再次对这项以 CC0 形式发布、作为对 Solana 生态贡献的成果致以深深的敬意和感谢。一个以 open source 形式发布的改进,再通过另一款 open-source 工具(SLV)交付到世界各地的 validator operators 手中——正是这样的知识共享循环,让整个 Solana 生态变得更强。对我们而言,也会继续通过 SLV,把从 ERPC 平台与 Epics DAO validator 运维中获得的知识持续回馈出去。

solana-sha256-hasher-optimized (kagren): https://github.com/kagren/solana-sha256-hasher-optimized

联系方式

如需咨询 SLV 与 ERPC,请在 Validators DAO 官方 Discord 中创建 support ticket。

Validators DAO Official Discord: https://discord.gg/C7ZQSrCkYR

链接

- SLV Website: https://slv.dev/zh

- SLV GitHub: https://github.com/validatorsDAO/slv

- ERPC Website: https://erpc.global/zh

- ERPC SLV AI Plans: https://erpc.global/zh/price/

- solana-sha256-hasher-optimized (kagren): https://github.com/kagren/solana-sha256-hasher-optimized

- Epics DAO Website: https://epics.dev/zh

- Validators DAO Official Discord: https://discord.gg/C7ZQSrCkYR